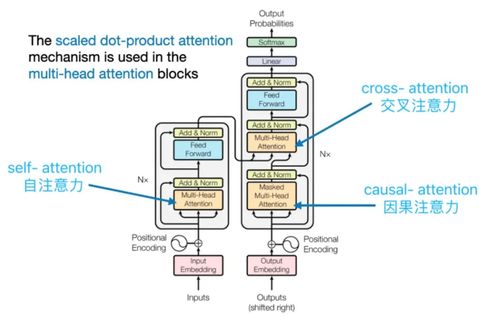

Transformer模型憑借其在自然語言處理等領(lǐng)域的卓越表現(xiàn),已成為人工智能領(lǐng)域的核心架構(gòu)。其成功背后,高效且強(qiáng)大的數(shù)據(jù)處理技術(shù)功不可沒。本文將通過動畫演示的視角,深入淺出地解析支撐Transformer高效運(yùn)行的四大數(shù)據(jù)處理關(guān)鍵技術(shù)。

1. 分詞與詞嵌入(Tokenization & Embedding)

數(shù)據(jù)處理的第一步是將原始文本(如句子、段落)轉(zhuǎn)化為模型可以理解的數(shù)字形式。這一過程首先通過分詞技術(shù),將連續(xù)的文本切分成有意義的單元(如單詞、子詞)。通過詞嵌入層,將這些離散的符號映射為高維空間中的連續(xù)向量。這個向量不僅包含了詞匯的語義信息,還為其在模型中的計(jì)算奠定了基礎(chǔ)。動畫可以生動展示一個句子如何被拆分成一個個Token,并像查表一樣轉(zhuǎn)換為一個個富含語義的向量。

2. 位置編碼(Positional Encoding)

Transformer模型摒棄了循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)的順序結(jié)構(gòu),其自注意力機(jī)制本身不具備感知單詞順序的能力。因此,位置編碼技術(shù)至關(guān)重要。它通過為每個詞向量添加一個包含其位置信息的獨(dú)特向量,將序列的順序信息顯式地注入模型。常用的方法是使用正弦和余弦函數(shù)來生成這些位置向量。動畫可以形象地展示這些如同“波紋”或“條形碼”的位置向量是如何逐位疊加到詞嵌入向量上,讓模型“知道”每個詞在句子中的先后次序。

3. 掩碼(Masking)

在訓(xùn)練過程中,尤其是在處理序列生成任務(wù)(如機(jī)器翻譯、文本摘要)時,模型需要遵循“不能偷看未來信息”的原則。掩碼技術(shù)在此扮演了關(guān)鍵角色。它通過在注意力權(quán)重矩陣的上三角區(qū)域(代表“未來”的詞)填充一個極大的負(fù)值(如負(fù)無窮),再經(jīng)過Softmax函數(shù)后,這些位置的注意力權(quán)重幾乎變?yōu)榱悖瑥亩帘瘟宋磥碓~對當(dāng)前詞的影響。動畫可以清晰地演示一個注意力矩陣如何通過掩碼操作,從全連接狀態(tài)變?yōu)橹魂P(guān)注當(dāng)前位置及之前歷史信息的“下三角”有效區(qū)域。

4. 批處理與填充(Batching & Padding)

為了充分利用GPU等硬件的并行計(jì)算能力,提高訓(xùn)練效率,模型通常同時處理多個樣本,即批處理。一個批次內(nèi)的文本序列往往長短不一。為了解決這個問題,填充技術(shù)被引入:將較短的序列末尾添加特定的填充符號(如[PAD]),使其長度與批次內(nèi)最長的序列保持一致,從而形成一個規(guī)整的張量。在計(jì)算注意力或損失時,需要忽略這些填充符號的影響。動畫可以展示不同長度的句子如何被“對齊”到同一長度,組成一個整齊的矩陣送入模型,以及注意力機(jī)制如何“忽略”那些填充部分。

分詞嵌入、位置編碼、掩碼以及批處理與填充,這四大數(shù)據(jù)處理技術(shù)如同精密的齒輪,協(xié)同工作,為Transformer模型提供了結(jié)構(gòu)規(guī)整、信息完備的輸入數(shù)據(jù),是其強(qiáng)大性能不可或缺的基石。通過動畫形式的揭秘,這些看似復(fù)雜的技術(shù)原理變得直觀易懂,讓我們得以一窺現(xiàn)代深度學(xué)習(xí)模型高效運(yùn)轉(zhuǎn)背后的數(shù)據(jù)藝術(shù)。